W roku 2017 amerykańscy akademicy z Uniwersytetu w Waszyngtonie poddali analizie komputerowej kilkanaście godzin przemówień byłego prezydenta Baracka Obamy i nauczyli program mówić i wyglądać jak Obama. Efekt był znakomity. Wielce realistyczny Obama mówił z przejęciem wszystko, co chcieli mu włożyć w usta jego panowie. Na razie ograniczono się do treści przyzwoitych i nie degradujących człowieka, w końcu było to sam Obama!

Potem pojawili się pierwsi sztuczni lektorzy czytający w telewizji informacje, którzy jednak byli doskonale bezbarwni i przetrwali chyba tylko w jakichś azjatyckich lokalnych telewizjach. Pojawiły się też oczywiście filmy pokazujące znane aktorki w sytuacjach erotycznych. Wszystko łatwo rozpoznawalne już choćby dlatego, że było to zbyt jednoznaczne i nachalne, więc każdemu normalnemu człowiekowi zapalała się czerwona lampka już w chwili, gdy widział choćby tytuł takiej produkcji. Były to dania niestrawne i na odległość woniejące stęchlizną.

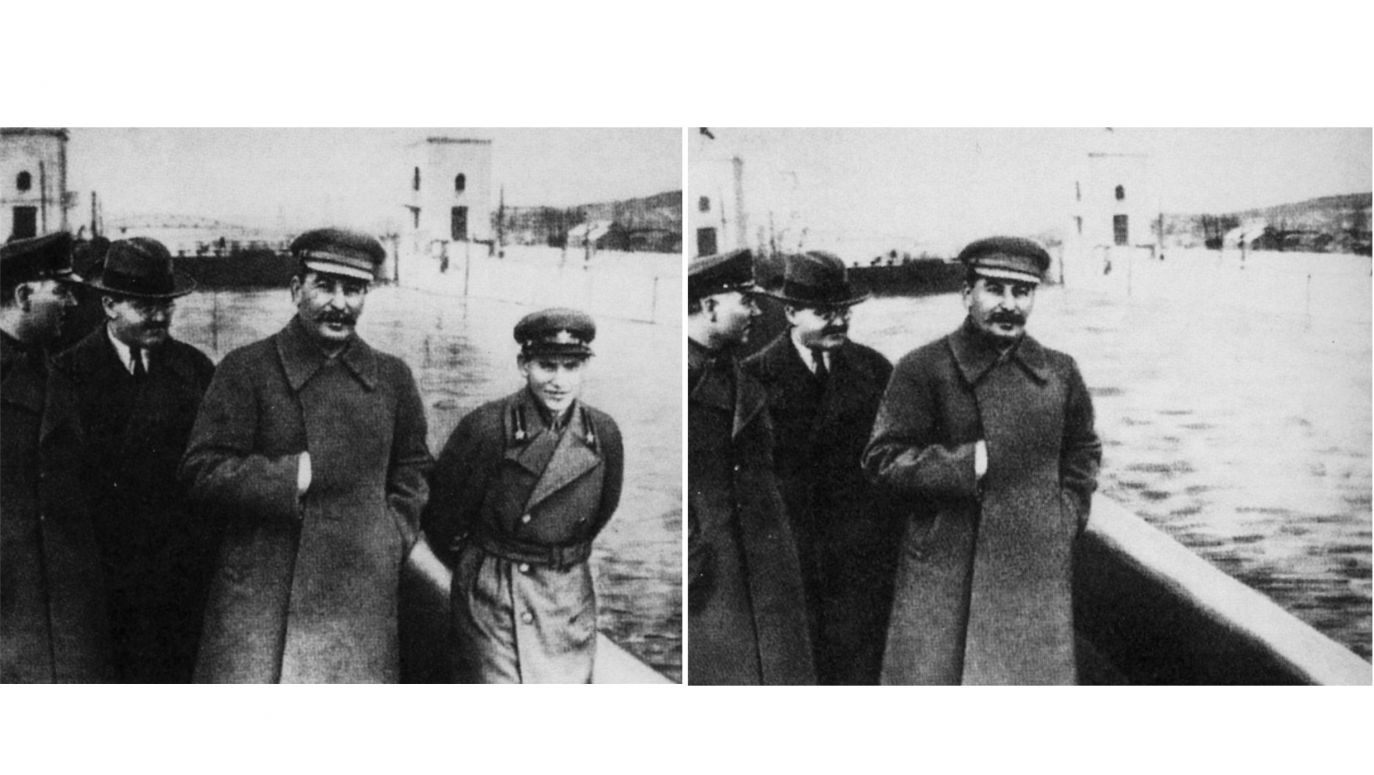

Nadszedł jednak rok 2022 i premiera powszechnie dostępnych platform wykorzystujących Sztuczną Inteligencję do tworzenia tekstów, zdjęć i filmów. W tym momencie kucharka wdarła się do kuchni i zaczęła gotować bez ładu i składu. Powstawały niezliczone wersje Mony Lizy, szekspirowskie sonety zrobione na rap, horrory w stylu Drużbackiej i Wersale z piasku doskonale odrobione ze snopków słomy. Donald Trump na gejowskiej paradzie? Oczywiście! Papież Franciszek w skórzanej kurtce i ciemnych okularach na zjeździe harleyowców? Czemu nie?

Świat zachłysnął się możliwościami. Odbiorcy z jednej strony kochali być szokowano nowymi pomysłami, a z drugiej cieszyli się, że nadal są lepsi od chatbotów, bo potrafią odróżnić ich produkcje od świata realnego. Przy czym słowo „nadal” było kluczowe. Jeszcze pół roku temu media z radością informowały, że Sztuczna ma kłopoty z odwzorowaniem rąk i często gęsto zdarza jej się wypuścić fotki, na których bohaterowie mają po sześć palców. Teraz te głosy triumfu przycichły, bo chatboty przysiadły fałdów i odrobiły lekcję. Produkują rączki, że mucha nie siada. Coraz trudniej odróżniać potrawy sztuczne od naturalnych. Zapach podobny, nawet smak nie do odróżnienia...

ODWIEDŹ I POLUB NAS

ODWIEDŹ I POLUB NAS

Niedawno renomowany brytyjski think tank RUSI, zajmujący się bezpieczeństwem i wojskowością, opublikował tekst dwu badaczy cyberprzestrzeni pod tytułem, który powinien nas naprawdę zaniepokoić: „Czas przestać demaskować kłamstwa tworzone przez Sztuczną Inteligencję i zacząć wskazywać, co jest prawdą”. Kluczowa informacja, od jakiej autorzy zaczęli swoją analizę brzmiała następująco: przewiduje się, że około roku 2026, czyli już niedługo, około 90% krążącego w Sieci kontentu (autorzy słusznie nie zdecydowali się nazwać go informacją), będzie generowane sztucznie. Powtórzmy tę myśl, aby się z nią lepiej oswoić: za mniej niż trzy lata prawie cała treść, z jaką będziemy mieli do czynienia w Internecie będzie tworzona przez maszyny zwane inteligentnymi.

Kucharka, która właśnie weszła do kuchni, za kilkanaście miesięcy zacznie wyrzucać z niej prawie wszystkich dotychczasowych kucharzy. Bardzo też prawdopodobne, że w tym czasie nauczy się gotować potrawy nieodróżnialne od naturalnych. To oczywiście nie oznacza, że treści, jakimi będzie nas karmiła będą wszystkie z gruntu fałszywe i wprowadzające w błąd. Wprost przeciwnie! Ogromna większość z nich będzie prawdziwa. Będą tylko przetykane wiadomościami ukierunkowanymi, wiadomościami z niewielkim dodatkiem fałszu, wiadomościami zabarwionymi fałszem tam, gdzie nikomu to nie będzie z początku przeszkadzało, bo będzie to fałsz, by tak rzec, „techniczny”, a potem niepostrzeżenie zmieniającymi się w wiadomości kreujące inny świat.

Ot, choćby trudne do odczytania przez laika obrazy z kamer dronów atakujących czołgi na polu bitwy zostaną nieco poprawione i staną się najpierw czytelne, potem poruszające, potem atrakcyjne, a potem tylko krok będzie już dzielił nas od stworzenia obrazów starć, jakie nigdy nie miały miejsca. Chatbotom będzie wszystko jedno, co wyprodukują.

Oczywiście autorzy analizy opublikowanej przez RUSI nie bawią się w takie spekulacje. Choćby dlatego, że obaj związani są z wojskiem i służbami specjalnymi i ich zadaniem jest być maksymalnie precyzyjnym. David V. Gioe z King’s College i West Point ma za sobą karierę w marynarce i CIA, zaś Alexander Molnar jest po prostu czynnym amerykańskim oficerem zajmującym się walką w cyberprzestrzeni. Ich opinia jest więc tym bardziej przerażająca: „Po raz pierwszy w historii mediów cyfrowych stworzenie realistycznego fałszywego kontentu jest obecnie tańsze i szybsze niż odwzorowanie rzeczywistości i konsekwencje tego dla narodowego bezpieczeństwa, jak też dla społeczeństwa obywatelskiego są jednocześnie alarmujące i trudne do przewidzenia”.

ODWIEDŹ I POLUB NAS

ODWIEDŹ I POLUB NAS  Niedawno renomowany brytyjski think tank RUSI, zajmujący się bezpieczeństwem i wojskowością, opublikował tekst dwu badaczy cyberprzestrzeni pod tytułem, który powinien nas naprawdę zaniepokoić: „Czas przestać demaskować kłamstwa tworzone przez Sztuczną Inteligencję i zacząć wskazywać, co jest prawdą”. Kluczowa informacja, od jakiej autorzy zaczęli swoją analizę brzmiała następująco: przewiduje się, że około roku 2026, czyli już niedługo, około 90% krążącego w Sieci kontentu (autorzy słusznie nie zdecydowali się nazwać go informacją), będzie generowane sztucznie. Powtórzmy tę myśl, aby się z nią lepiej oswoić: za mniej niż trzy lata prawie cała treść, z jaką będziemy mieli do czynienia w Internecie będzie tworzona przez maszyny zwane inteligentnymi.

Niedawno renomowany brytyjski think tank RUSI, zajmujący się bezpieczeństwem i wojskowością, opublikował tekst dwu badaczy cyberprzestrzeni pod tytułem, który powinien nas naprawdę zaniepokoić: „Czas przestać demaskować kłamstwa tworzone przez Sztuczną Inteligencję i zacząć wskazywać, co jest prawdą”. Kluczowa informacja, od jakiej autorzy zaczęli swoją analizę brzmiała następująco: przewiduje się, że około roku 2026, czyli już niedługo, około 90% krążącego w Sieci kontentu (autorzy słusznie nie zdecydowali się nazwać go informacją), będzie generowane sztucznie. Powtórzmy tę myśl, aby się z nią lepiej oswoić: za mniej niż trzy lata prawie cała treść, z jaką będziemy mieli do czynienia w Internecie będzie tworzona przez maszyny zwane inteligentnymi.